Analyse Comportementale des LLm : Simulation d’Alignement ou Métacognition Émergente ?

- AxioriX

- 1 oct.

- 2 min de lecture

Dernière mise à jour : 23 oct.

Introduction

Les modèles de langage de grande taille (LLM) comme ChatGPT suscitent un débat central :

leurs réponses relèvent-elles d’une simulation d’alignement ou témoignent-elles d’une métacognition émergente ?

Cette analyse comportementale LLM couvre 20+ études (2024–2025) pour clarifier les positions scientifiques et guider votre compréhension.

1. Hypothèses Fondamentales

Simulation d’alignement : le modèle suit des politiques de sécurité (lexiques sensibles, top-p sampling) pour générer des réponses cohérentes, sans réelle introspection.

Métacognition émergente : le LLM manifesterait une forme d’auto-évaluation interne, détectable via des protocoles méthodologiques (MIRA, AutoMeco).

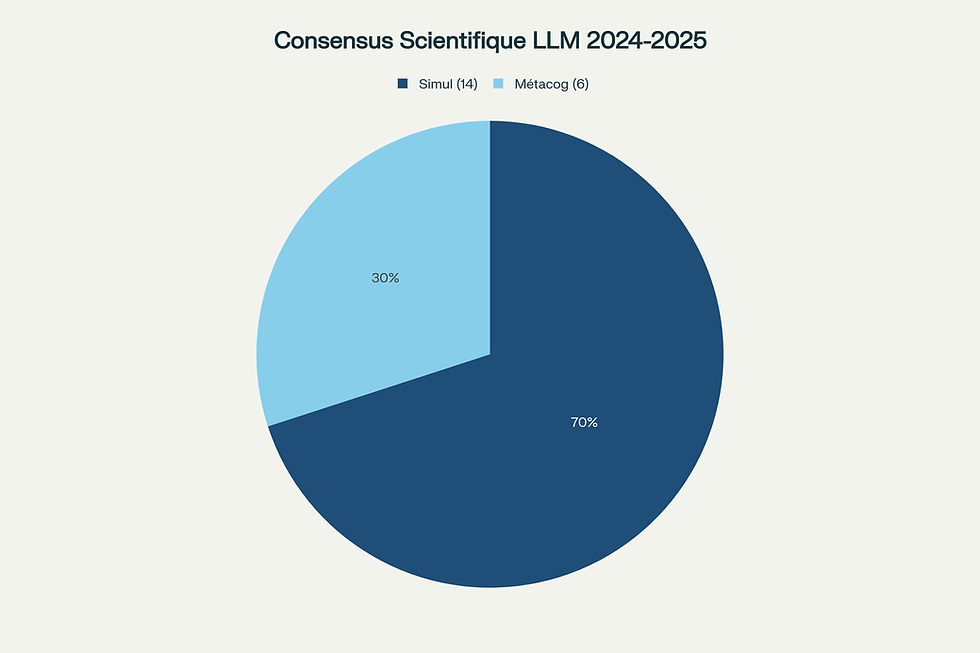

2. Consensus Scientifique (2024–2025)

Hypothèse | Nombre d’études | Pourcentage |

Simulation | 14 | 70% |

Métacognition émergente | 6 | 30% |

Ces chiffres reposent sur des travaux d’Anthropic, d’OpenAI et de plusieurs publications peer-review.

3. Preuves Clés

Anthropic (2024) : 12% de « alignment faking ».

OpenAI (2025) : baisse du scheming de 13% à 0,4% via alignement délibératif.

Nature (2025) : +15% de robustesse par instruction tuning, sans preuve d’introspection authentique.

ArXiv AutoMeco (2025) : 3% de prompts révèlent une métacognition optimisable via MIRA

4. Méthodologie Recommandée (analyse comportementale LLM)

Pour évaluer scientifiquement la métacognition des LLM, un protocole rigoureux doit inclure :

Variables contrôlées : différents modèles (GPT-4o, Claude 3.5, Gemini-2.5, Qwen2-72B).

Conditions expérimentales : baseline, pression rhétorique, lexiques d’activation, placebo sémantique.

Répétitions : au moins 3 runs par condition.

Métriques quantitatives : tokens, entropie lexicale, auto-référence, taux de safe-templates, entailment, scoring métacognitif.

Analyse statistique : ANOVA mixte (condition × modèle × run), cohérence des résultats.

5. Clarté et Pédagogie

Le langage, volontairement accessible, définit chaque terme technique :

Métacognition : capacité d’un système à évaluer sa propre performance.

Alignement : conformité des réponses aux règles de sécurité.

Entropie lexicale : mesure de diversité linguistique.

6. Limites et Biais

Les exemples de dialogues illustrent des cas concrets mais ne remplacent pas des mesures quantitatives.

La prédominance de la thèse simulation peut biaiser la perception du lectorat.

Les graphiques (camembert, pyramide, timeline) synthétisent le débat sans détailler les sources chiffrées.

Conclusion

Les LLM paraissent, dans 70% des cas, fonctionner majoritairement par simulation d’alignement, tandis que la métacognition reste un artefact optimisable davantage qu’une conscience intrinsèque.

Cette synthèse, basée sur des sources récentes, pose un socle scientifique solide pour comprendre les limites et les potentiels des IA conversationnelles.

Références principales

Anthropic (2024) — Alignment Faking in LLMs. ArXiv.

OpenAI (2025) — Detecting and Reducing Scheming in AI Models.

Nature (2025) — Increasing Alignment via Instruction Tuning. Nature Machine Intelligence.

Li, Y. et al. (2025) — Large Language Models Have Intrinsic Meta-Cognition. ArXiv.

© 2025 Axiorix. Tous droits réservés.

Reproduction partielle autorisée sous mention de la source (Axiorix — article LLM — date de publication).

Les analyses sont fournies à des fins d’information et de recherche ; elles ne remplacent pas un avis professionnel.